К 2026 году 90% всего интернет-контента будет создано нейросетями. Такой прогноз* сделали ученые из Европола, анализируя, с какой скоростью искусственный интеллект заменяет живых авторов в интернете. Как распознать сгенерированный текст, нужно ли это делать и всегда ли «искусственный текст» равно «плохой текст»? В этой статье расскажем, что думаем об AI-детекторах после того, как командой контент-агентства title написали более 3000 текстов на заказ… и все проверили на «человечность», согласно техническому заданию.

*https://www.europol.europa.eu/operations-services-and-innovation/innovation-lab

*https://www.europol.europa.eu/operations-services-and-innovation/innovation-lab

С чего все началось

Помните этот момент, когда мир узнал о текстовых возможностях Chat GPT? Первые месяцы с нейротекстами носились, как с диковинкой: создавали посты в стиле Кинга и удивлялись, что машина пишет лучше нанятого смм-щика. Было совсем не стыдно и даже гордо выложить в соцсети сгенерированный текст. Копирайтеры напряглись.

Затем восторги поутихли: при более близком рассмотрении оказалось, что в GPT-статьях (особенно если их не редактировать) много шаблонов, канцеляритов, одинаковых оборотов. Только авторы распробовали нейронку в качестве помощника, как в технических заданиях стали появляться запреты на использование ИИ.

Сначала проверка этого требования осуществлялась на уровне ощущений: похож или не похож? Но вскоре появились они — AI-детекторы, определяющие не просто владельца текста, а даже процент человечности и ИИ-чности. С одним из таких нам пришлось столкнуться на практике впервые полгода назад.

Затем восторги поутихли: при более близком рассмотрении оказалось, что в GPT-статьях (особенно если их не редактировать) много шаблонов, канцеляритов, одинаковых оборотов. Только авторы распробовали нейронку в качестве помощника, как в технических заданиях стали появляться запреты на использование ИИ.

Сначала проверка этого требования осуществлялась на уровне ощущений: похож или не похож? Но вскоре появились они — AI-детекторы, определяющие не просто владельца текста, а даже процент человечности и ИИ-чности. С одним из таких нам пришлось столкнуться на практике впервые полгода назад.

Как мы доказывали машине, что мы люди

«Можете использовать нейросети для написания текстов, но сервис должен показывать human-result не меньше 50%», так прокомментировала компания-заказчик техническое задание, в котором одним из требований была проверка на AI-детекторе. Само задание состояло в создании нескольких тысяч карточек-описаний мобильных приложений.

Вот как это условие прокомментировал сам заказчик

На тот момент команда авторов title уже слышала о вероятности пессимизации сайтов, на которых присутствуют сгенерированные тексты, поэтому взялась за этот эксперимент с профессиональным интересом. Пока что запомним комментарий заказчика: вернемся к его обсуждению после того, как расскажем о своем опыте.

Задачу мы реализовывали через Chat GPT и DeepSeek, которые после минимальной редактуры и фактчекинга выдавали вполне сносные описания аркад и стрелялок. К каждой карточке мы прикладывали скриншот проверки текста на ИИ-чность. После нескольких этапов «дрессировки» нейронок, тексты проходили проверку даже с первого раза, но в процессе обнаружились любопытные моменты.

Эти наблюдения зародили первые зерна сомнений в целесообразности таких проверок. И, конечно, помогли вывести лайфхаки, как их обойти.

Задачу мы реализовывали через Chat GPT и DeepSeek, которые после минимальной редактуры и фактчекинга выдавали вполне сносные описания аркад и стрелялок. К каждой карточке мы прикладывали скриншот проверки текста на ИИ-чность. После нескольких этапов «дрессировки» нейронок, тексты проходили проверку даже с первого раза, но в процессе обнаружились любопытные моменты.

- AI-детектор мог посчитать следами искусственного интеллекта название приложения, слова вроде «интернет» или «заключение» и даже предлоги.

- Результат мог меняться, даже если раз за разом вставлять в окно проверки один и тот же текст (мы проверяли).

- Ручной рерайт «недостаточно человеческого» текста далеко не всегда срабатывал: часто становилось только хуже.

Эти наблюдения зародили первые зерна сомнений в целесообразности таких проверок. И, конечно, помогли вывести лайфхаки, как их обойти.

Как победить AI-детектор

Если текст устраивает всех, кроме AI-детектора, с ним тоже можно постараться «договориться». Например:

Насколько эти способы отражают то, как должен выглядеть «человеческий» текст, — вопрос спорный для человека, но однозначный для AI-детектора. Если прохождение такой проверки критично для технического задания и вступать в полемику с заказчиками не хочется, то можно механически доводить показатель до нужного процента.

Однако у нас осталось желание разобраться. Мы провели собственное расследование, откуда взялись такие требования и действительно ли в них есть смысл.

- Вставляйте на проверку неформатированный текст: без списков и структуризации.

- Убирайте слова «Введение» и «Заключение». Их алгоритмы почему-то определяют как искусственные.

- Если даже переписанный и упрощенный до предела текст все равно высвечивается как нечеловеческий, прогоните его по очереди через несколько проверок. Иногда сервис внезапно выдает противоположные результаты.

Насколько эти способы отражают то, как должен выглядеть «человеческий» текст, — вопрос спорный для человека, но однозначный для AI-детектора. Если прохождение такой проверки критично для технического задания и вступать в полемику с заказчиками не хочется, то можно механически доводить показатель до нужного процента.

Однако у нас осталось желание разобраться. Мы провели собственное расследование, откуда взялись такие требования и действительно ли в них есть смысл.

Почему мы стали меньше доверять ИИ-текстам

Нашлось две причины и, спойлер, одна из них вымышленная.

Плохая репутация текстов из машины — засорение интернета ИИ-контентом низкого качества. Созданные в ранних версиях Chat GPT по невнятным промтам, такие статьи на 80% состояли из «воды», а еще на 20% — из плохо переписанных источников не первой свежести. Отсюда уверенность в том, что ИИ способен создать только примитивные и недостоверные тексты, не нужные ни читателям, ни поисковым роботам.

Вместе с тем, по данным компании Originality.ai, уже сейчас доля AI-контента в интернете достигла 20%. То есть каждый пятый текст или изображение, которое вы видите, созданы не человеком.

Вторая причина — конспирологическая, потому что родилась в головах интернет-пользователей без видимых на то оснований. Звучит она так же, как комментарий к нашему техническому заданию на описание карточек: «Поисковые системы начали пессимизировать контент, созданный при помощи нейросетей».

В качестве одного из свежих доказательств часто приводится цитата из мартовского пресс-релиза Яндекса об очередных новациях в поисковой выдаче: «…точность определения низкокачественных документов, включая те, что были созданы с помощью ИИ, возросла до 99%». Давайте разберемся, в чем здесь правда.

Плохая репутация текстов из машины — засорение интернета ИИ-контентом низкого качества. Созданные в ранних версиях Chat GPT по невнятным промтам, такие статьи на 80% состояли из «воды», а еще на 20% — из плохо переписанных источников не первой свежести. Отсюда уверенность в том, что ИИ способен создать только примитивные и недостоверные тексты, не нужные ни читателям, ни поисковым роботам.

Вместе с тем, по данным компании Originality.ai, уже сейчас доля AI-контента в интернете достигла 20%. То есть каждый пятый текст или изображение, которое вы видите, созданы не человеком.

Вторая причина — конспирологическая, потому что родилась в головах интернет-пользователей без видимых на то оснований. Звучит она так же, как комментарий к нашему техническому заданию на описание карточек: «Поисковые системы начали пессимизировать контент, созданный при помощи нейросетей».

В качестве одного из свежих доказательств часто приводится цитата из мартовского пресс-релиза Яндекса об очередных новациях в поисковой выдаче: «…точность определения низкокачественных документов, включая те, что были созданы с помощью ИИ, возросла до 99%». Давайте разберемся, в чем здесь правда.

Что говорит Яндекс

Если прочитать весь текст, речь в нем идет лишь об усилении контроля за качеством контента. Поисковик расширил критерии ранжирования, и на первом месте уже не формальное наличие ключевиков, а степень полезности для читателя.

Этот подход стал особенно актуальным из-за растущего объема информации и ускорения производства контента низкого качества, в том числе с помощью ИИ. Хотя такой контент может содержать необходимые ключевые слова и формально соответствовать запросу, он не несет ценности для пользователя

Блог Яндекса для вебмастеров

На то, что будет ограничиваться именно ИИ-контент, никаких указаний нет.

Что говорит Google

Компания официально заявляет, что не наказывает контент только за то, что он создан с помощью AI. Ключевое — соответствие принципам E-E-A-T. Это оценка контента по четырем критериям: опыт (Experience), экспертность (Expertise), авторитетность (Authoritativeness) и надежность (Trustworthiness).

Например, статью о лечении диабета, написанную эндокринологом на сайте медицинского центра, Google сочтет более качественной и заслуживающей доверия, чем такой же текст на неизвестном блоге без указания автора. А писал ли врач ее сам или с формулировками и фактурой ему помог Chat GPT, поисковику совершенно не важно. Если статья полезна и оригинальна — в топ выдачи она вполне может залететь.

Согласно исследованию сервиса Semrush, влияние контента ИИ на SEO полностью зависит от одного: качества публикуемого контента. 39% опрошенных пользователей утверждают, что получают даже больше органического трафика благодаря использованию ИИ. Вероятно, из-за того, что сгенерированный текст легче читается, он более организован и лучше оптимизирован.

По данным того же исследования, 65% маркетологов, использующих ИИ для создания контента, отметили улучшение результатов SEO за последние полгода.

Например, статью о лечении диабета, написанную эндокринологом на сайте медицинского центра, Google сочтет более качественной и заслуживающей доверия, чем такой же текст на неизвестном блоге без указания автора. А писал ли врач ее сам или с формулировками и фактурой ему помог Chat GPT, поисковику совершенно не важно. Если статья полезна и оригинальна — в топ выдачи она вполне может залететь.

Согласно исследованию сервиса Semrush, влияние контента ИИ на SEO полностью зависит от одного: качества публикуемого контента. 39% опрошенных пользователей утверждают, что получают даже больше органического трафика благодаря использованию ИИ. Вероятно, из-за того, что сгенерированный текст легче читается, он более организован и лучше оптимизирован.

По данным того же исследования, 65% маркетологов, использующих ИИ для создания контента, отметили улучшение результатов SEO за последние полгода.

Когда AI-контент может быть пессимизирован?

Хотя сам факт использования AI не вызывает санкций, поисковики все же могут пессимизировать или исключить контент из индексации, если он:

Такие тексты классифицируются как спам вне зависимости от того, созданы они искусственным интеллектом или неопытными копирайтерами.

- создан в больших объемах без добавления ценности для пользователей;

- имеет низкое качество, содержит ошибки или вводит в заблуждение;

- создан исключительно для манипуляции поисковыми алгоритмами.

Такие тексты классифицируются как спам вне зависимости от того, созданы они искусственным интеллектом или неопытными копирайтерами.

Эксперимент: тест-драйв сервисов по определению ИИ

Рабочего кейса и официальных исследований нам показалось мало, и мы решили провести свой собственный эксперимент, чтобы проверить качество ИИ-детекторов. Взяли несколько популярных сервисов и попросили их угадать, кто написал текст, который дали на проверку. Для чистоты эксперимента, текст попросили создать нейросеть DeepSeek и после генерации не меняли в нем ни буквы.

Текст, который мы использовали для эксперимента

Этот на 100% сгенерированный текст попросили проверить в самых популярных сервисах: GPT Zero, Getmerlin, Retext.ai, Text.ru, Chat GPT и DeepSeek.

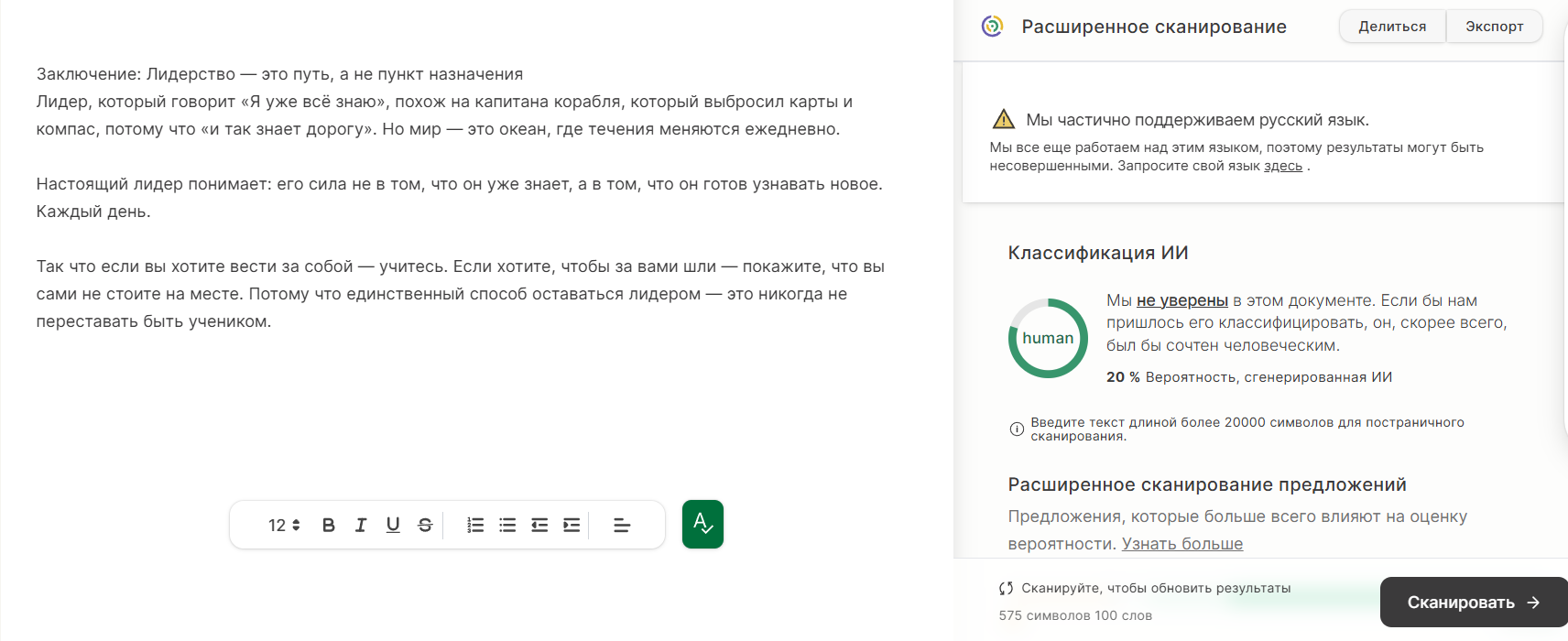

GPT Zero

Мы начали с GPT Zero — сервиса, который нам прописал в ТЗ заказчик описаний для мобильных приложений. Его результат: вероятность того, что текст написан ИИ, всего 20%.

Результат проверки на GPT Zero

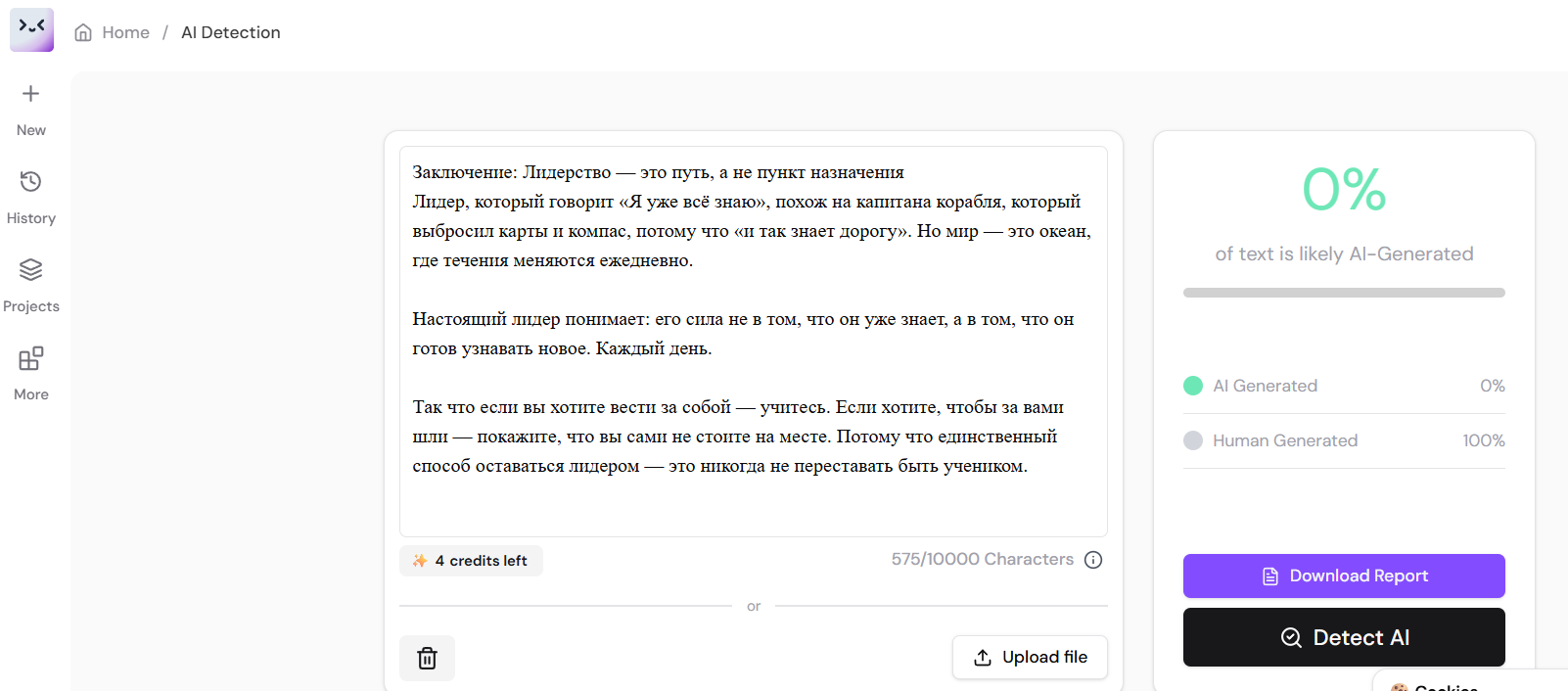

Getmerlin

ИИ-сервис, вшитый в Chrome, оказался более лояльным. Его решение: текст создан человеком с вероятностью 100%.

Результат проверки на Getmerlin

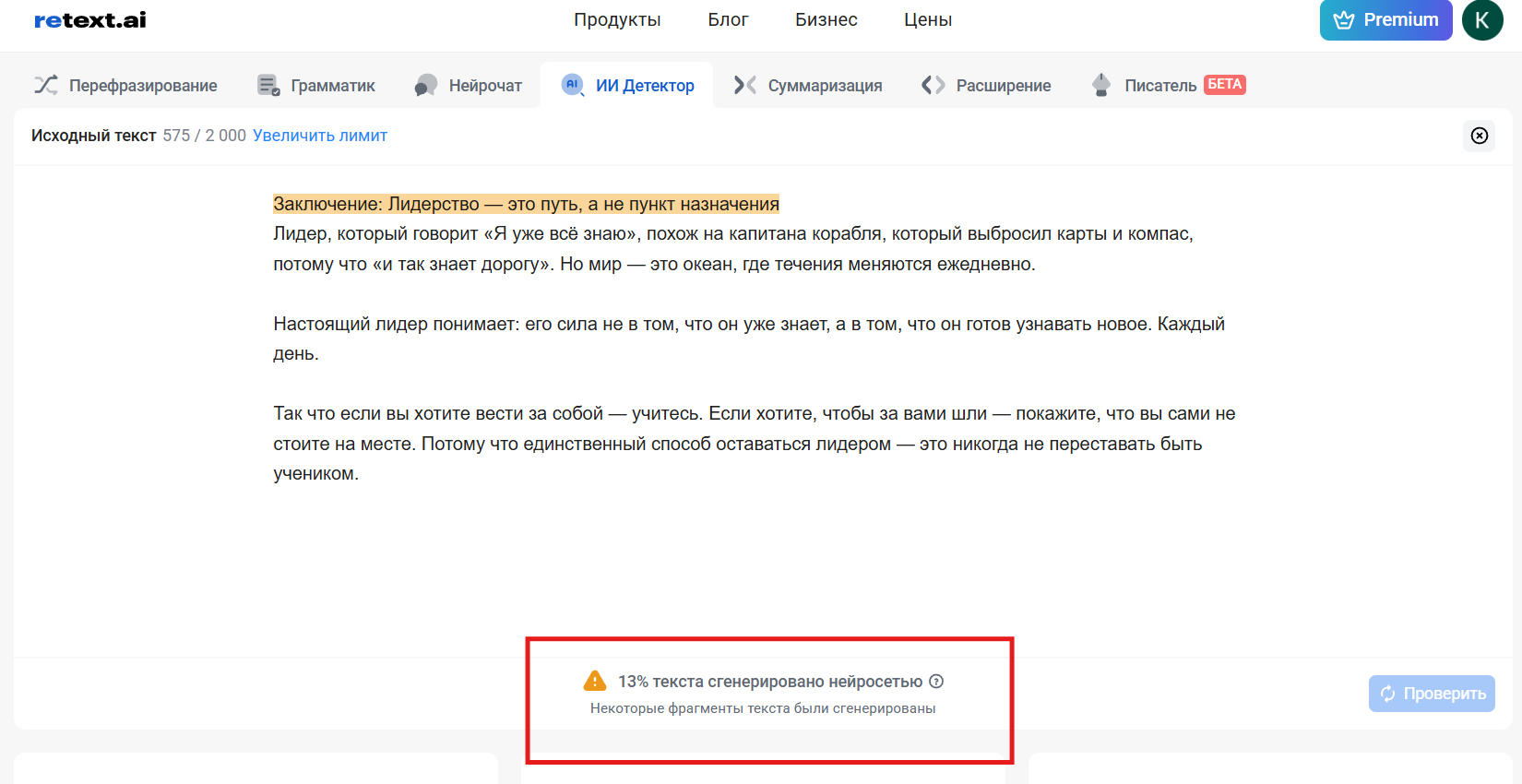

Retext.ai

Retext.ai решил, что весь наш текст написан человеком, кроме заголовка.

Результат проверки на Retext.ai

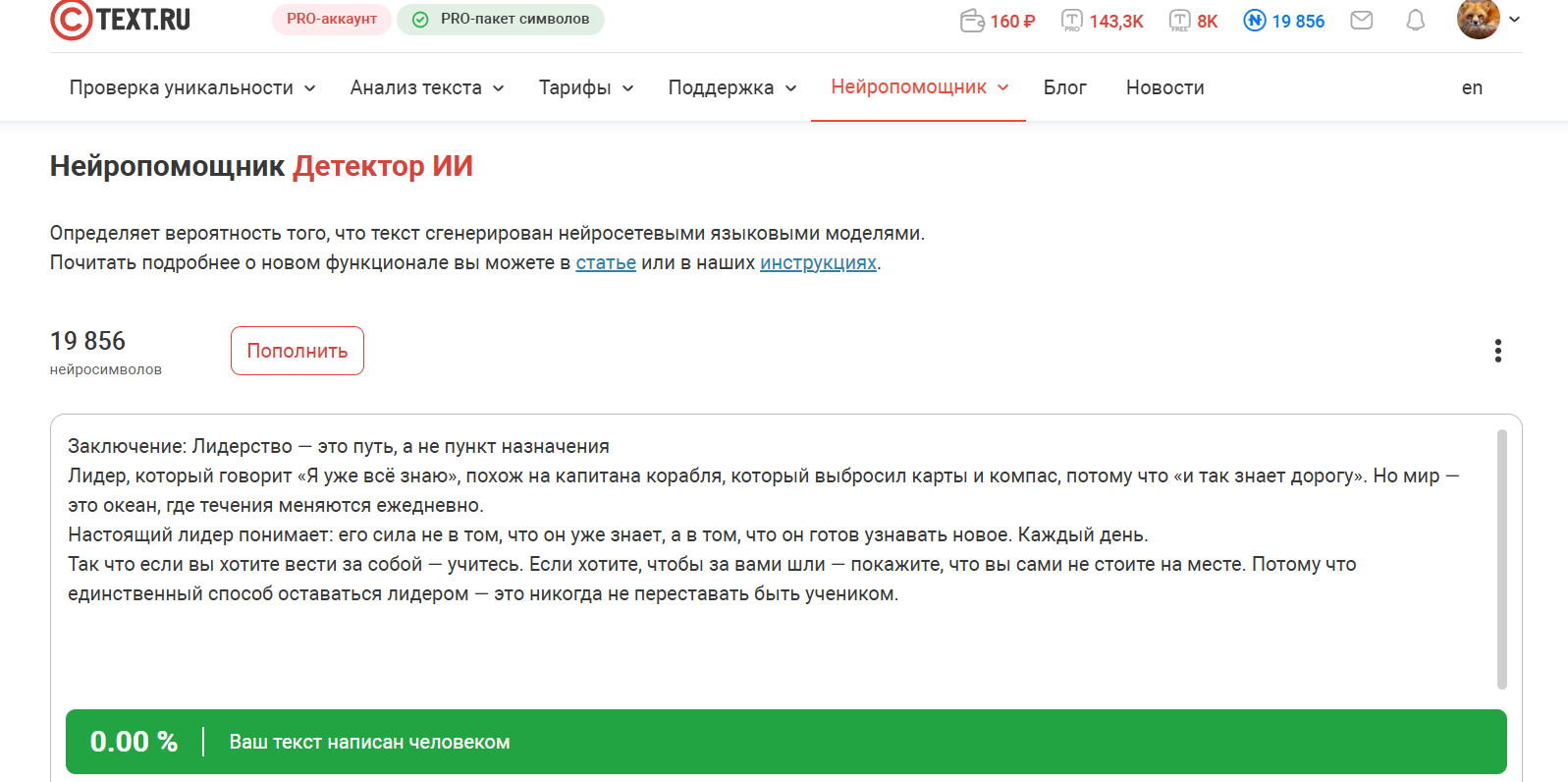

Text.ru

Сервис Текст.ру — один из самых качественных в нашей нише. Пройти на нем проверку на уникальность сложнее всего: программа находит совпадения с источниками, которые другим сервисам незаметны. Тем не менее, нашу генерацию Текст.ру определил как человеческую на сто процентов.

Результат проверки на Text.ru

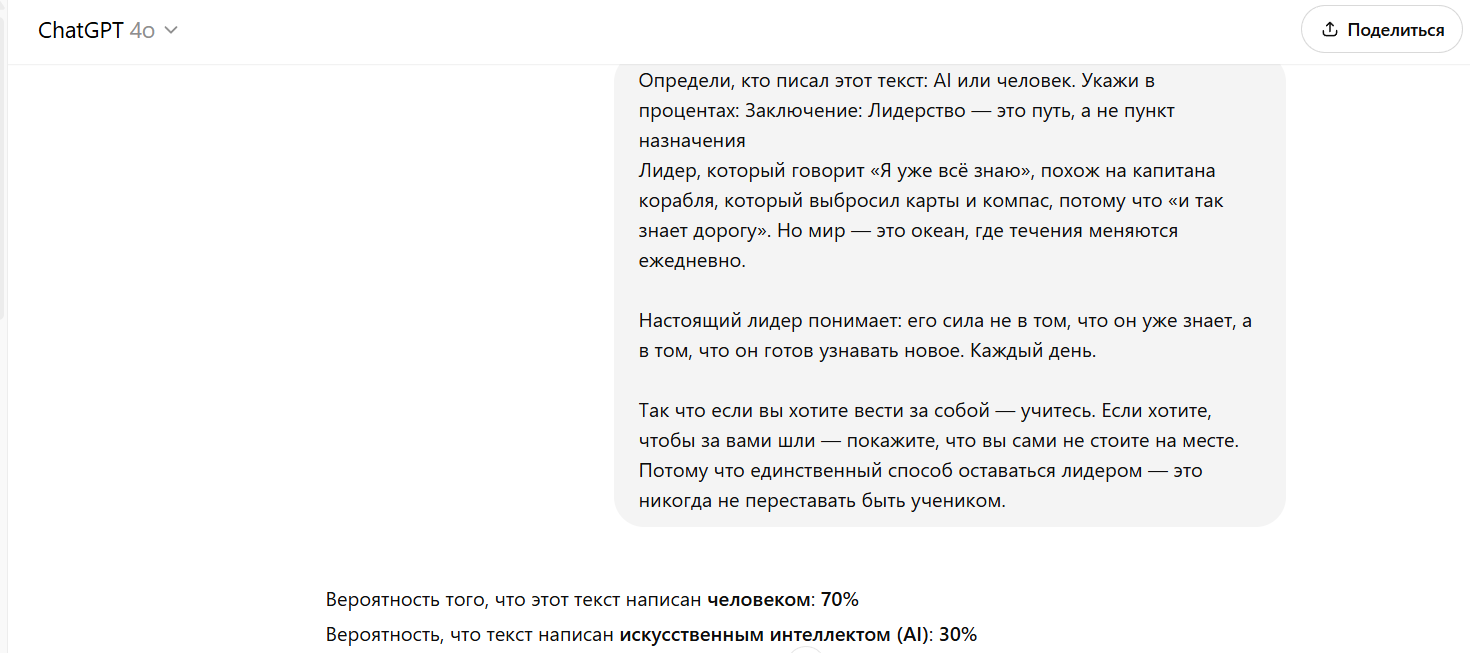

Chat GPT

Нейросети также могут выступить в качестве ИИ-детектора. Правда, доверять им можно тоже с осторожностью. Наш машинописный абзац GPT определил как человеческий на 70%.

Результат проверки на Chat GPT

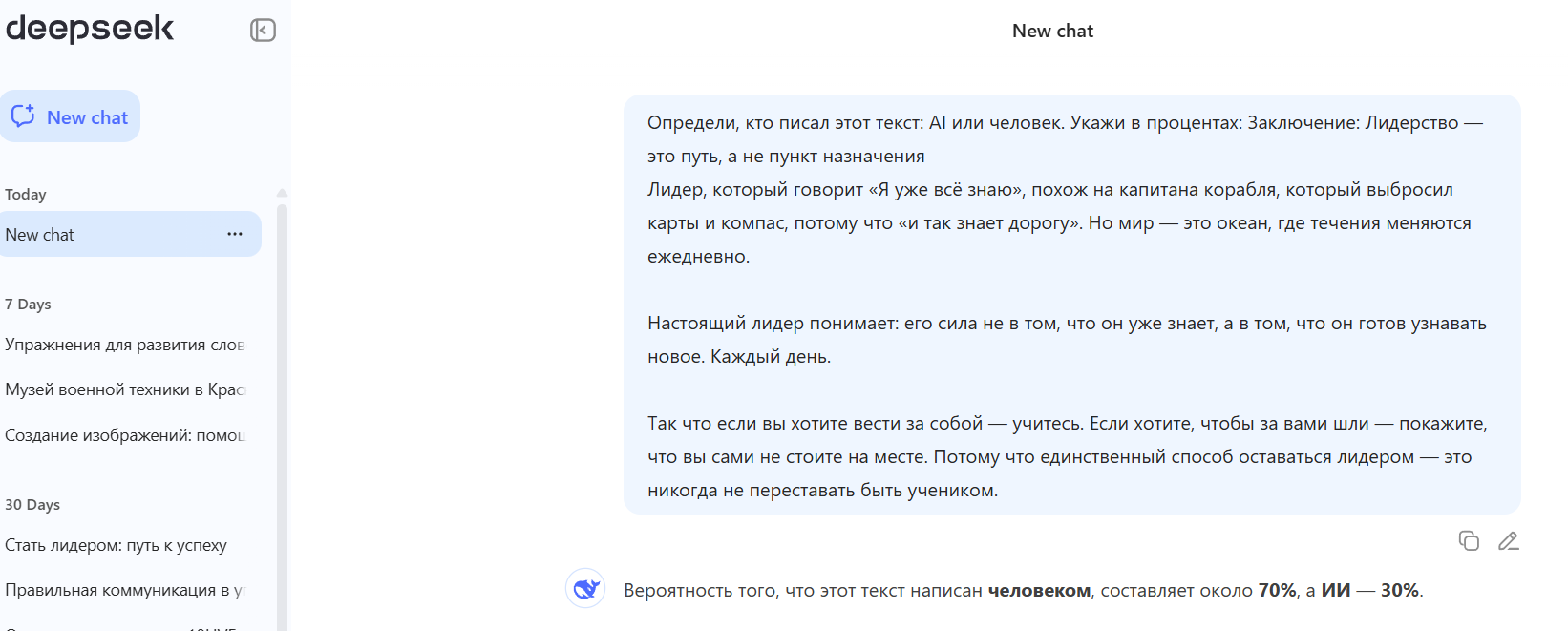

DeepSeek

Может ли нейросеть не узнать собственное творение? Еще как. Текст, созданный DeepSeek, сама же нейронка определила как на 70% человеческий.

Результат проверки на DeepSeek

Правильный диагноз нашему тесту не поставил ни один ИИ-детектор. Вопрос о доверии к подобным сервисам можно считать закрытым.

Как понять, что текст написан ИИ: признаки сгенерированного текста

Главное, на что вы должны полагаться, — это собственные ощущения. Если вы видите откровенно небрежный текст с кучей повторов, пустых фраз и канцеляризмов, вероятнее всего, его сотворил робот по некачественному промту. Хотя живые копирайтеры с этой задачей тоже неплохо справляются, вот несколько явных признаков ИИ-текста.

В последнее время признаками GPT-текста стали считать длинные тире, маркированные списки и кавычки-елочки. В среде коллег-копирайтеров нередко встречаются сетования на то, что приходится изменять привычкам грамотности и ставить «лапки» и короткие тире, лишь бы никто не заподозрил в работе через нейросети.

- «Произвел революцию в…» самолетостроении, картофелеводстве, трансплантологии и черт знает в чем еще. Любое описываемое явление нейросеть пытается представить более значимым, и делает это чаще всего одними и теми же выражениями.

- Нейросеть не скупится на такие сентенции, как: «важная задача (проблема)» или «имеет огромное значение для…», «неотъемлемая часть», «является ключевым элементом», «играет существенную роль», «позволяет существенно…». В общем, вся та водица, которую мы лили во время написания дипломных работ, чтобы нарастить объем.

- И любимое: «Введение» и «Заключение». Да, в техзаданиях начало и финал статьи обозначены чаще всего так, но когда эти определения пролезают в тело текста, он становится похожим на школьный реферат, написанный роботом.

В последнее время признаками GPT-текста стали считать длинные тире, маркированные списки и кавычки-елочки. В среде коллег-копирайтеров нередко встречаются сетования на то, что приходится изменять привычкам грамотности и ставить «лапки» и короткие тире, лишь бы никто не заподозрил в работе через нейросети.

Не смогли удержаться: этот мем очень в тему

Пользуясь случаем, хотим напомнить: это обычные нормы русского языка. Более того, именно такой формат требуют адекватные редакции. Корректная пунктуация — это не повод провоцировать проверки.

Коротко о главном

Поисковые системы не понижают в выдаче нейротексты только за то, что их писала машина. Пессимизируется некачественный контент вне зависимости от авторства.

Проверкам на AI-детекторе доверять нельзя. То ли их алгоритмы стареют быстрее, чем развиваются нейронки, то ли генераторы текстов действительно научились делать тексты, которые хочется читать.

Поверхностный текст, наполненный общими фразами и канцеляризмами, может написать и человек, и машина. Как и хороший текст.

Проверкам на AI-детекторе доверять нельзя. То ли их алгоритмы стареют быстрее, чем развиваются нейронки, то ли генераторы текстов действительно научились делать тексты, которые хочется читать.

Поверхностный текст, наполненный общими фразами и канцеляризмами, может написать и человек, и машина. Как и хороший текст.

Комментарий основателя агентства копирайтинга title Анастасии Рейзес

(Заключение) Вместо заключения

Недавние разговоры о том, как нейросети отправят всех копирайтеров на завод, разбились о реальность. Коммерческие авторы не только выжили как класс, но и вполне себе приручили новые технологии, увеличив количество производимых за единицу времени «килознаков» контента.

Но если в первые год-полтора с момента запуска Chat GPT люди на упоминание нейросетей смотрели с интересом, то сейчас все ровно наоборот. Из-за массовости применения нейровозможностей, их ценность снизилась. Человечеству снова захотелось «живых» историй с приятным послевкусием, а не шаблонных нагромождений контента из машины.

Конечно, ни одно агентство, производящее буквы, от нейросетей сейчас не откажется. И даже самый естественный, «человеческий» текст может оказаться продуктом хорошего промта. Но если контент хорош, так ли важно, как именно он был создан?

Но если в первые год-полтора с момента запуска Chat GPT люди на упоминание нейросетей смотрели с интересом, то сейчас все ровно наоборот. Из-за массовости применения нейровозможностей, их ценность снизилась. Человечеству снова захотелось «живых» историй с приятным послевкусием, а не шаблонных нагромождений контента из машины.

Конечно, ни одно агентство, производящее буквы, от нейросетей сейчас не откажется. И даже самый естественный, «человеческий» текст может оказаться продуктом хорошего промта. Но если контент хорош, так ли важно, как именно он был создан?